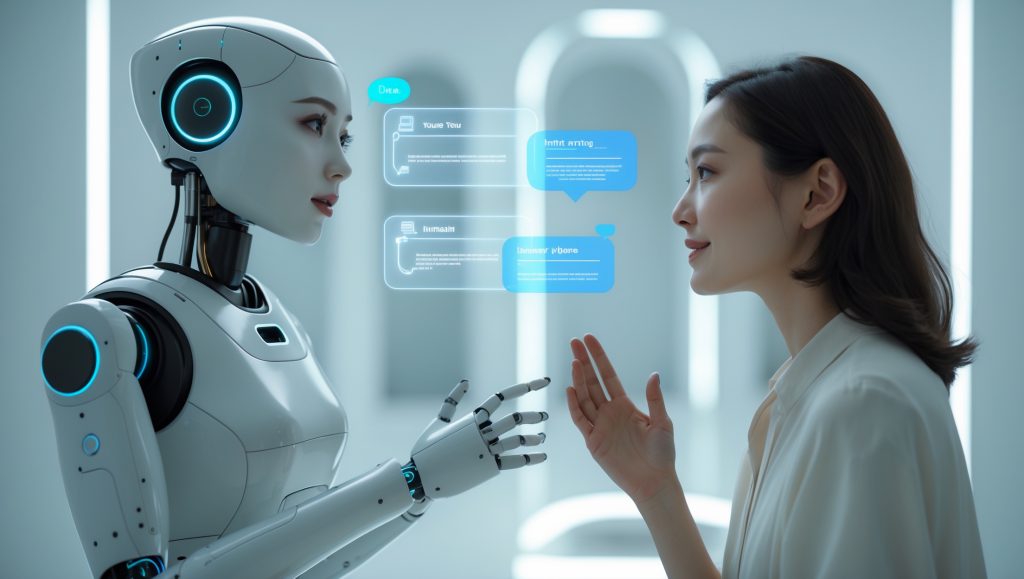

A medida que la inteligencia artificial se integra en decisiones cada vez más importantes —como diagnósticos médicos, créditos financieros o recomendaciones educativas— surge una pregunta clave: ¿por qué tomó esa decisión? Aquí es donde entra la IA explicativa, una evolución necesaria que busca algo más que resultados precisos: busca transparencia, comprensión y confianza.

Transparencia: saber cómo y por qué decide

La IA explicativa permite que los modelos muestren, de forma clara y accesible, los factores que influyeron en sus decisiones. Ya no se trata de confiar a ciegas, sino de entender la lógica detrás de cada resultado. Esto es clave en sectores donde las decisiones impactan directamente en la vida de las personas.

Comprensión: el usuario también importa

Un sistema es verdaderamente útil cuando el usuario comprende cómo funciona. La IA explicativa pone el foco en el entendimiento humano, no solo en la eficiencia matemática. Esto permite que personas sin conocimientos técnicos puedan interactuar con confianza y tomar decisiones informadas.

Confianza: tecnología que genera seguridad

Cuando los sistemas automatizados explican sus procesos, se reduce el miedo a errores ocultos o sesgos. Esto fortalece la confianza del usuario, especialmente en contextos donde se requiere responsabilidad ética. En lugar de reemplazar al juicio humano, la IA explicativa lo respalda.

Mejora continua: aprender del usuario

La retroalimentación humana es clave para el crecimiento de los algoritmos. Un modelo explicativo no solo comunica su lógica, también recibe información sobre sus aciertos y errores. Esto permite perfeccionar su rendimiento, reducir sesgos y aumentar su precisión con el tiempo.

Una IA más humana y responsable

La inteligencia artificial del futuro no solo será poderosa, sino también transparente y comprensible. La IA explicativa representa un paso necesario para construir sistemas más éticos, confiables y centrados en las personas. Porque en la era de la automatización, entender es tan importante como predecir.